NEW ⏱ 1分

2026/05/15

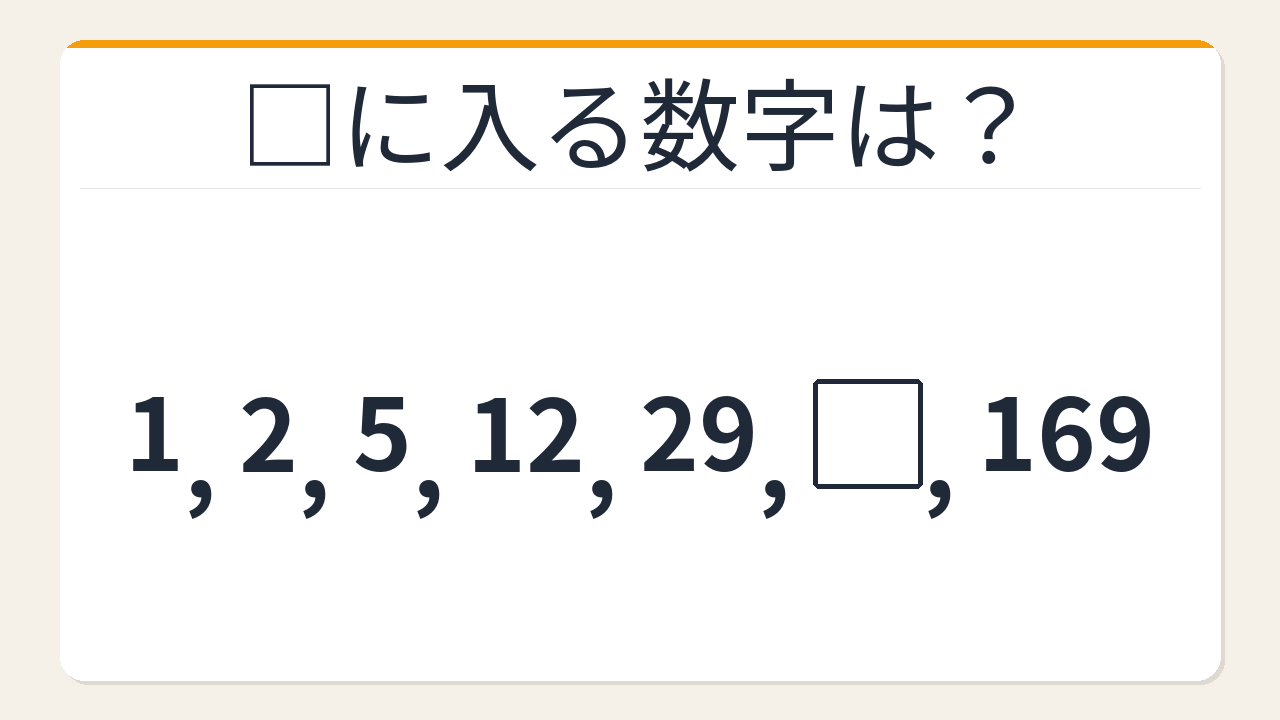

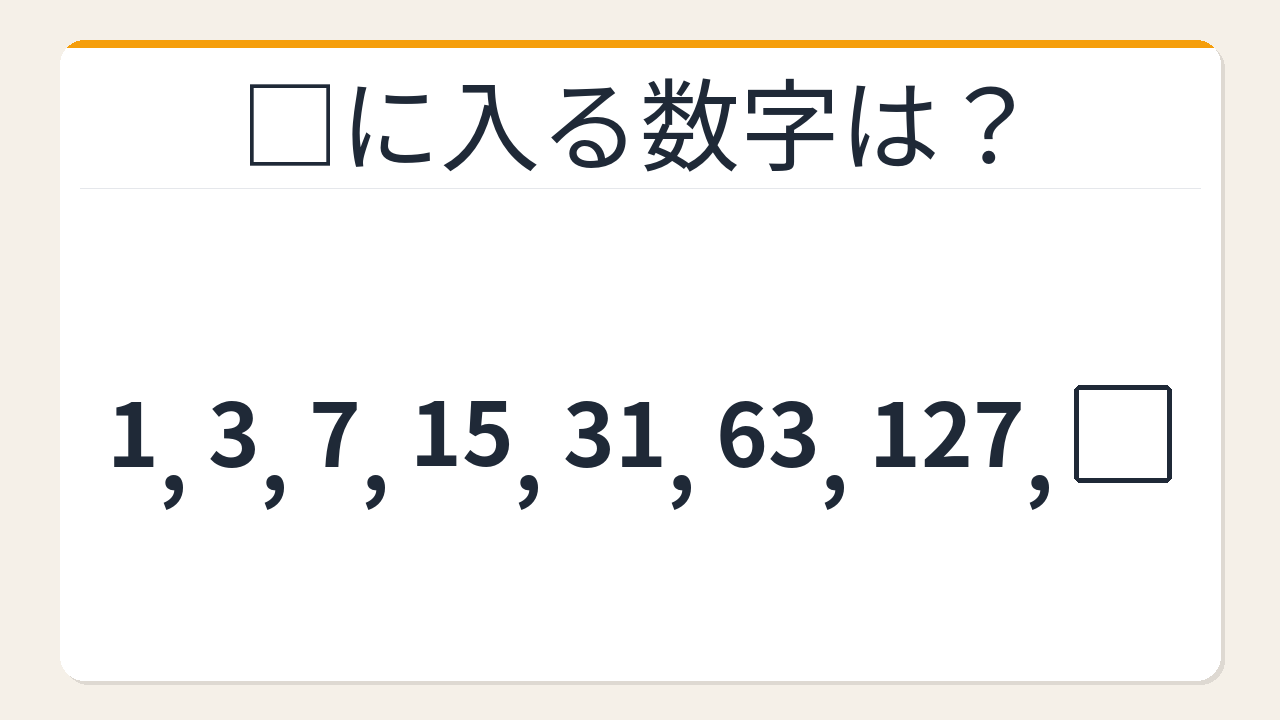

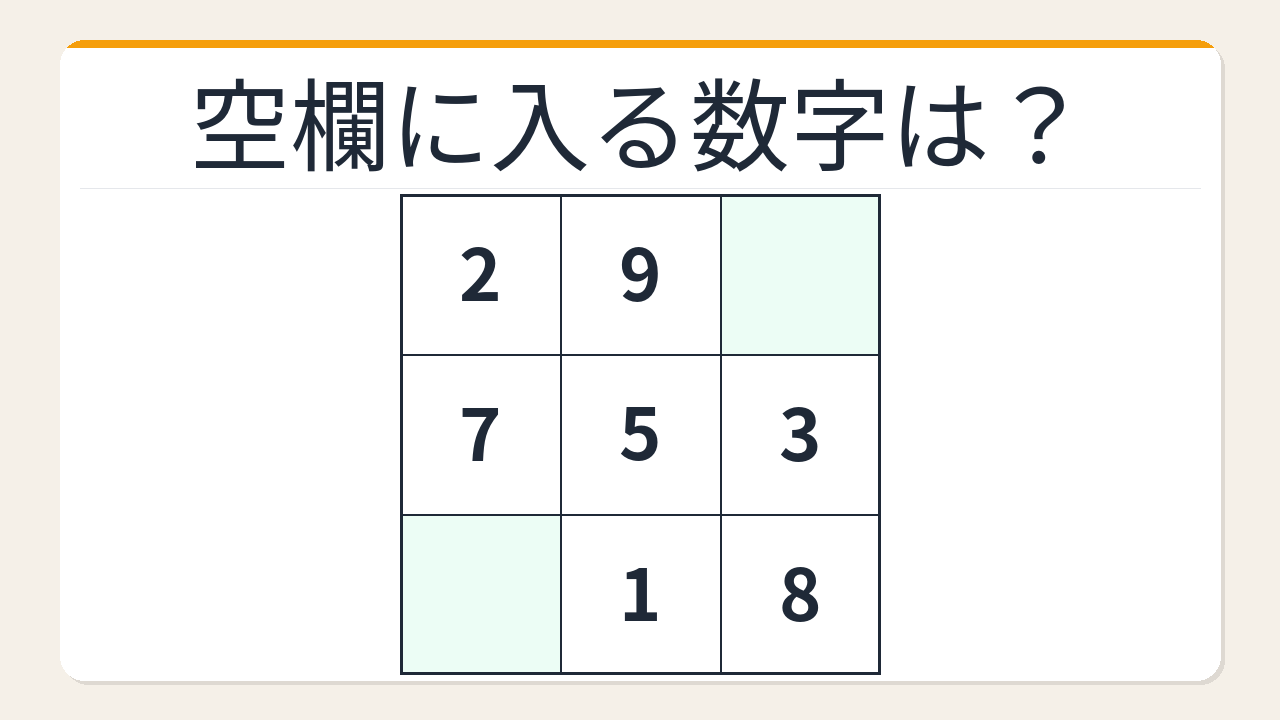

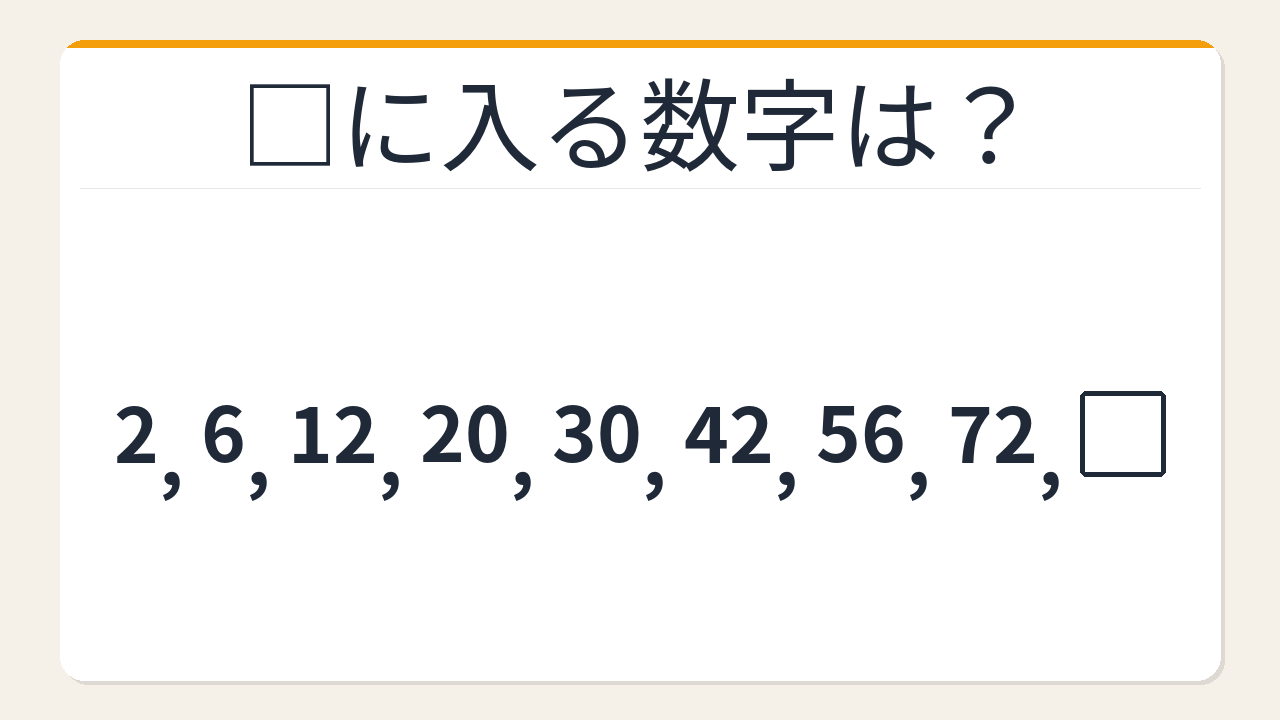

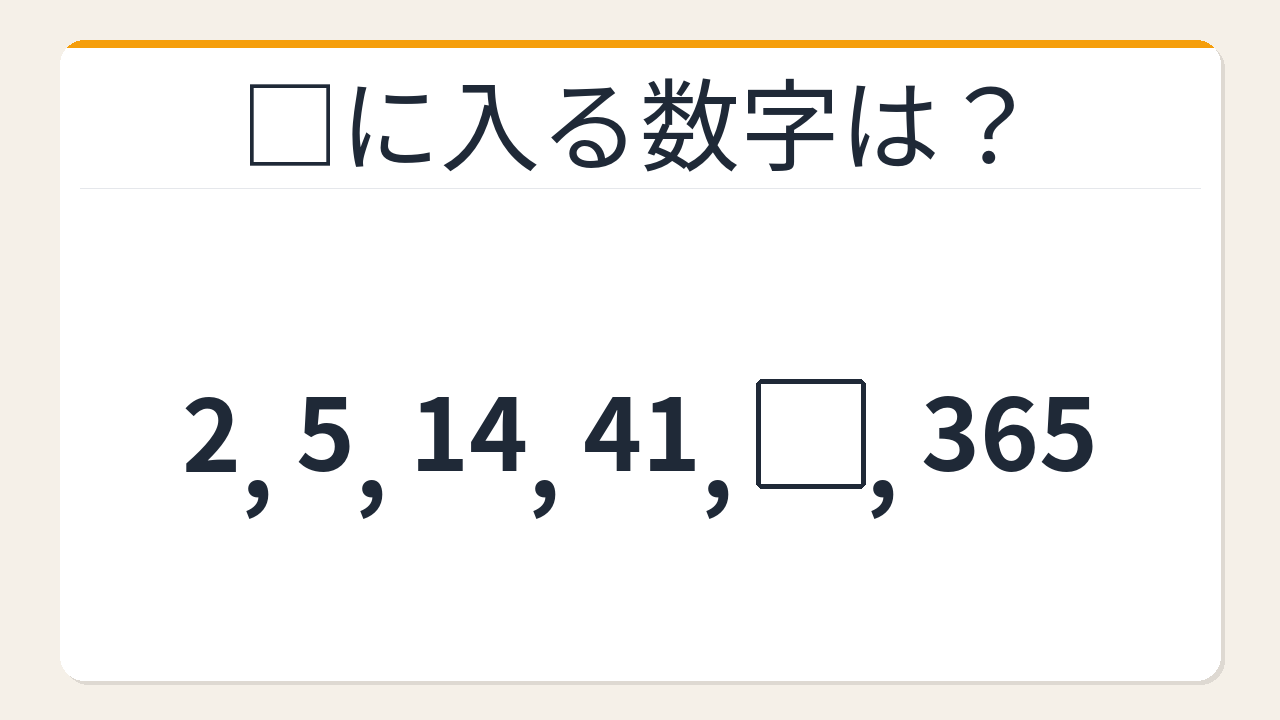

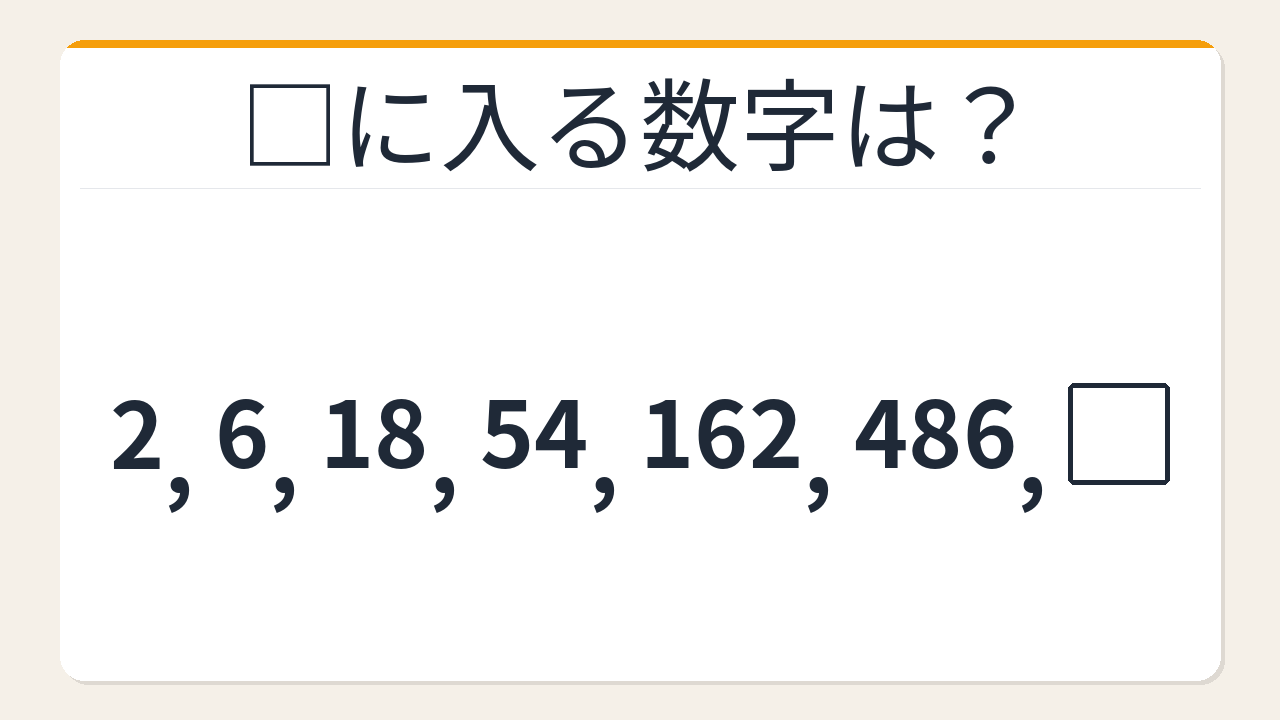

答え合わせ

なぜそうなるかを知ると、次の挑戦がもっと楽しくなります。

RLHFとは「Reinforcement Learning from Human Feedback」の略で、人間のフィードバックを使ってAIモデルを強化学習させる手法です。具体的には、AIが生成した複数の回答を人間が比較・評価し、より良い回答を学習させていきます。この手法によって、AIは単に文法的に正しいだけでなく、人間にとって有用で安全な回答を生成できるようになりました。OpenAIがChatGPTを開発する際にこのRLHFを大規模に採用したことで、一気に注目を集めました。現在ではGoogleのGeminiやAnthropicのClaudeなど、主要なAIモデルの多くがこの手法を活用しています。AIの「alignment(整合性)」を実現するための重要な技術として、AI業界では必須の知識となっています。

AIが賢く振る舞える裏には、人間の地道な評価作業があるんですね。次回もAIの知識をアップデートできるクイズをお届けします!